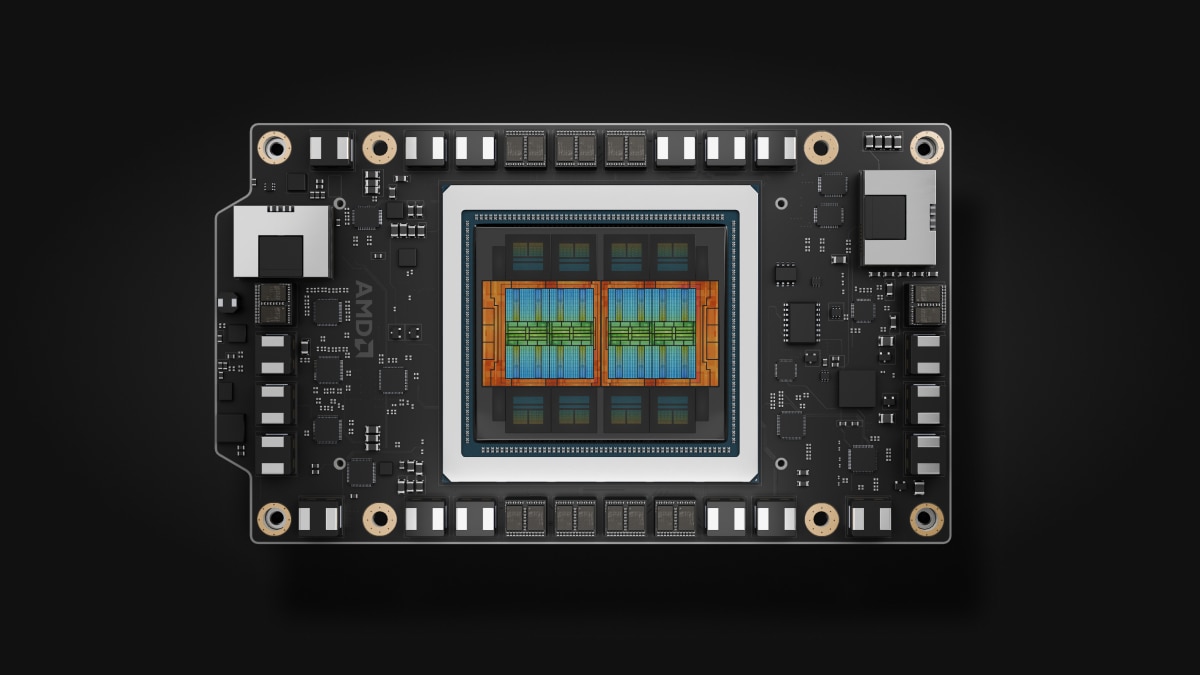

A AMD apresentou novos detalhes sobre sua próxima geração de chips para data centers voltados à inteligência artificial: a linha Instinct MI400. A plataforma tem lançamento previsto para 2026 e foca em oferecer alta escalabilidade.

Segundo a fabricante, o hardware será baseado em uma nova arquitetura chamada Helios, capaz de operar até 72 GPUs Instinct MI400 em sincronia, o que garante não apenas escalabilidade, mas também até 10 vezes mais desempenho em tarefas de inferência de IA.

- Leia também: AMD lança Radeon RX 9060 XT em 8 e 16 GB para 1440p

“Pela primeira vez, desenhamos cada parte do rack [de servidores] como um sistema único”, destacou Lisa Su, CEO da AMD, ao comentar a capacidade de combinar diferentes chips em um único servidor Helios. “Com a nova geração de GPUs, conseguimos entregar até 2,9 exaflops de performance em FP4 por rack. Isso representa um salto gigantesco em capacidade de processamento, com maior eficiência energética e menor custo por token”, completou a executiva.

Mesmo composto por diferentes chipsets — ou “cérebros”, por assim dizer —, o Helios funcionará como uma única máquina superpoderosa. Os novos chips serão compatíveis com memória HBM3E, o novo formato FP4 e terão integração com o UA-Link, um padrão de interconexão aberto criado pela AMD como alternativa ao NVLink, da Nvidia.

Oferecer escalabilidade a data centers é um dos pilares de uma infraestrutura robusta para inteligência artificial. Essa elasticidade permite expandir o poder computacional sem reestruturar toda a arquitetura do servidor, ao mesmo tempo que garante a conversão dos aprimoramentos em ganhos reais de performance.

A proposta do Helios lembra bastante o sistema de interoperabilidade dos chips Blackwell, da Nvidia, que também pode empilhar até 72 chipsets em um único conjunto.

AMD e OpenAI: parceria estratégica no MI450

Outro destaque do evento foi o anúncio do Instinct MI450, um novo chip voltado para GPUs de data centers desenvolvido em colaboração com a OpenAI.

Embora a OpenAI seja uma das maiores clientes da Nvidia, essa parceria com a AMD pode sacudir o mercado, especialmente em um cenário cada vez mais competitivo em performance, escalabilidade e, principalmente, custo.

Para Sam Altman, a colaboração está alinhada aos valores da OpenAI. O CEO conta que, além de desenvolver modelos, a dona do ChatGPT também busca tornar modelos mais eficientes, seguros e acessíveis.

Hoje, a AMD já atua no segmento de IA com o MI355X, chip que, de acordo com a empresa, começou a ser fabricado em maio deste ano.

- Confira: Loja brasileira vaza nova placa de vídeo da AMD mais baratinha

Quer saber como a corrida pelos chips de IA pode transformar o futuro da computação? Continue acompanhando o TecMundo para mais novidades sobre as gigantes do setor. Estamos no Instagram, YouTube, TikTok, X e Facebook com tudo o que você precisa saber sobre tecnologia!